IA pública y secreto profesional: el nuevo riesgo invisible para la abogacía

Alejandro Carranza

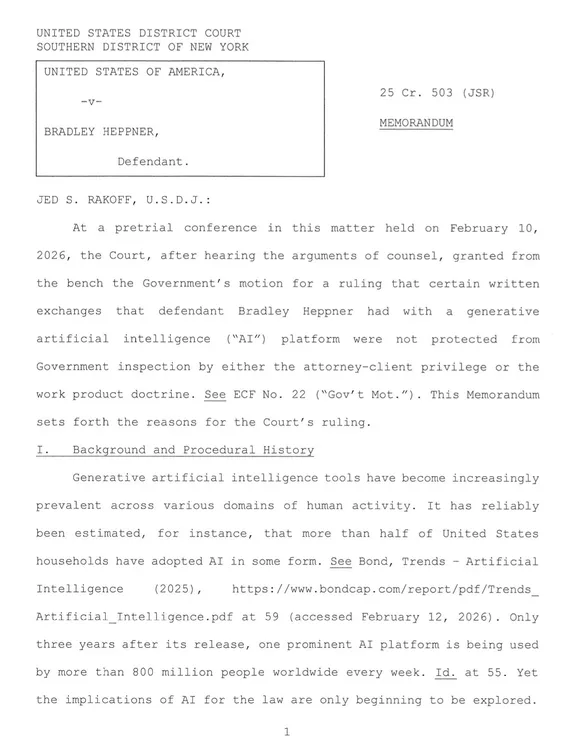

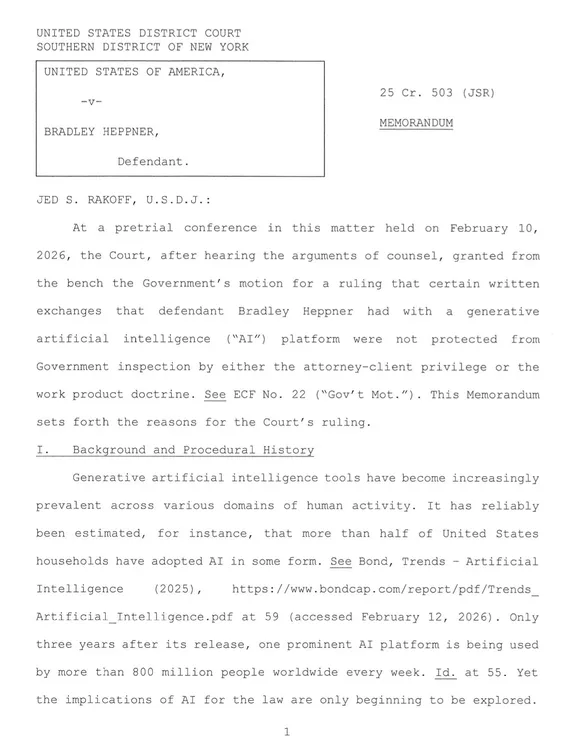

Alejandro CarranzaLa incorporación de inteligencia artificial en la práctica jurídica avanza más rápido que la reflexión sobre sus efectos. Sin embargo, un reciente precedente judicial —United States v. Heppner— obliga a replantear una cuestión central: cuándo el uso de estas herramientas compromete el secreto profesional.

El caso marcó un punto de inflexión. Un imputado utilizó un chatbot para analizar su situación, procesar información vinculada a su defensa y generar documentos que luego circularon en el marco del proceso. Cuando ese material fue incautado, el tribunal rechazó su protección bajo el privilegio abogado-cliente y la doctrina del work product.

La razón no fue tecnológica, sino jurídica. El tribunal aplicó principios clásicos: el privilegio exige una comunicación confidencial entre cliente y abogado, destinada a obtener asesoramiento legal. En este caso, la inteligencia artificial no calificaba como abogado y, más relevante aún, su uso implicaba la intervención de un tercero.

Ese es el núcleo del problema. Desde la perspectiva del derecho probatorio, interactuar con una IA pública equivale a divulgar información fuera del ámbito protegido. Y esa divulgación, en general, implica la pérdida del privilegio.

IA Pública?

Pero ¿cuándo una inteligencia artificial es “pública”? No se trata de una categoría técnica, sino funcional. Una IA debe considerarse pública cuando no existen garantías suficientes de confidencialidad: acceso abierto, uso de datos para entrenamiento, ausencia de acuerdos específicos, infraestructura compartida o falta de control sobre almacenamiento y jurisdicción. En esos casos, el sistema deja de ser una herramienta y pasa a operar como un tercero.

La consecuencia práctica es contundente. Lo que el usuario percibe como una interacción privada —una conversación en pantalla— puede ser interpretado jurídicamente como una comunicación abierta. La interfaz engaña: la privacidad aparente no equivale a confidencialidad legal.

El fallo también deja otra advertencia: no toda utilización de inteligencia artificial implica la pérdida del privilegio. El criterio determinante sigue siendo el control. Sistemas cerrados, con contratos adecuados, sin uso de datos para entrenamiento y bajo dirección del abogado, pueden acercarse al concepto de auxiliar profesional y preservar la protección.

El verdadero desafío, entonces, no es prohibir la tecnología, sino gobernarla. La abogacía enfrenta un cambio de contexto en el que prácticas antes seguras pueden volverse riesgosas sin que el profesional lo advierta.

En términos operativos, la regla es simple: si no se puede determinar con precisión quién accede a la información, cómo se utiliza, dónde se almacena y bajo qué obligaciones de confidencialidad, la herramienta debe ser tratada como un tercero externo. Y, por lo tanto, su uso puede implicar la renuncia al secreto profesional.

La enseñanza de Heppner es clara. La inteligencia artificial no modifica los fundamentos del derecho, pero sí expone nuevas formas de vulnerarlos. En la práctica cotidiana, una consulta mal canalizada ya no es solo un error metodológico: puede convertirse en evidencia.

En la era de la IA, la confidencialidad sigue siendo un pilar de la abogacía. La diferencia es que ahora requiere algo más que discreción: exige comprensión tecnológica y control jurídico.

En rigor, el problema no es la inteligencia artificial en sí misma, sino el modo en que se la utiliza. El resultado del caso Heppner probablemente habría sido distinto si los documentos hubiesen sido elaborados por el abogado, aun con asistencia de IA, bajo su dirección y dentro de un entorno de confidencialidad. Allí, la tecnología opera como una herramienta y no como un tercero.

El riesgo aparece cuando ese perímetro se rompe: cuando el cliente interactúa por su cuenta con sistemas abiertos, introduce información sensible y transforma, sin advertirlo, su propia estrategia en material potencialmente accesible. A esto se suma una advertencia que excede el ámbito profesional y alcanza a la ciudadanía: las herramientas de IA pueden ofrecer respuestas plausibles, pero carecen del contexto completo del caso, de acceso a la prueba y de responsabilidad jurídica sobre lo que sugieren. Utilizarlas como sustituto del asesoramiento legal no solo puede conducir a errores de criterio, sino también a decisiones que comprometan derechos. En ese cruce entre apariencia de precisión y ausencia de control, la confianza puede volverse un factor de riesgo.

❌ Qué fue lo que rompió todo en Heppner

El problema no fue “usar IA”, sino cómo se usó:

- el cliente actuó por su cuenta

- sin dirección del abogado

- en una plataforma abierta

- compartiendo información sensible

👉 Eso genera un doble efecto:

- no hay trabajo profesional protegido

- hay divulgación a un tercero

IA pública y secreto profesional: el nuevo riesgo invisible para la abogacía

El Colegio de la Abogacía en pie de guerra: denuncian que la reforma laboral "ataca" el ejercicio profesional

Juan Bautista Mahiques, nuevo ministro de Justicia: Milei oficializó el recambio en el Gabinete

IA pública y secreto profesional: el nuevo riesgo invisible para la abogacía